O Abismo entre o Silício e o Carbono

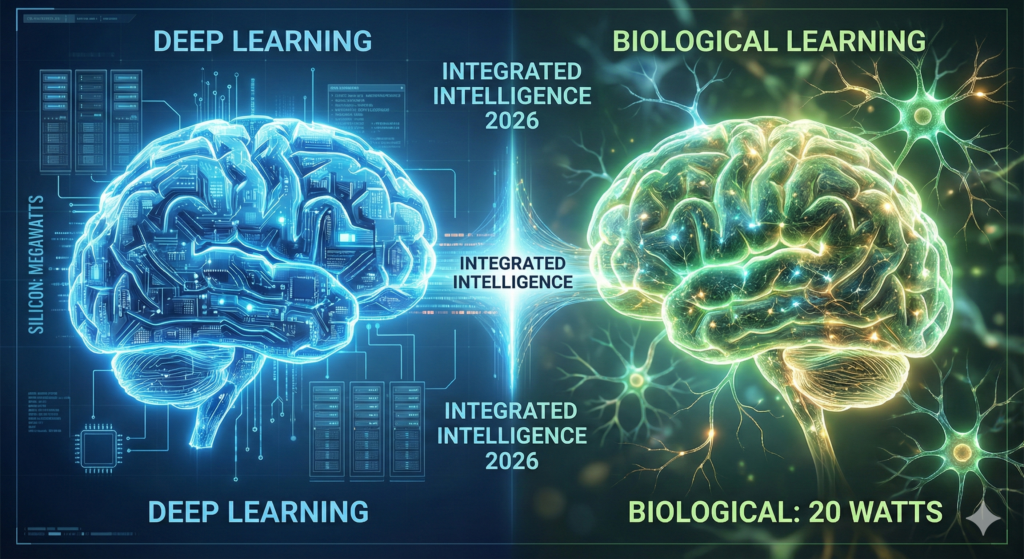

A busca por replicar a inteligência humana em máquinas gerou, nas últimas décadas, o campo do Deep Learning (Aprendizado Profundo). Contudo, apesar dos avanços astronômicos dos Grandes Modelos de Linguagem (LLMs) e da ascensão da IA Agêntica em 2026, existe um abismo fundamental entre como uma rede neural artificial aprende e como o cérebro biológico processa informações. Dessa maneira, a fronteira da inovação hoje não está apenas em criar modelos com trilhões de parâmetros, mas em entender por que o cérebro continua sendo o mestre supremo da eficiência, da generalização e da resiliência sob condições de incerteza extrema.

Nesse sentido, este artigo propõe uma análise profunda e técnica sobre as divergências ontológicas entre o aprendizado profundo e o aprendizado biológico. Exploraremos como a arquitetura do silício tenta mimetizar a biologia e onde ela falha de forma drástica devido a limitações físicas e algorítmicas. Além disso, discutiremos como a convergência desses dois mundos está moldando a nova geração de inteligência artificial híbrida. Portanto, prepare-se para uma jornada que atravessa o cálculo diferencial, a neurobiologia molecular e a física da informação termodinâmica.

I. O Paradoxo Energético e a Termodinâmica do Cálculo

Uma das diferenças mais gritantes entre o Deep Learning e o Biological Learning reside na eficiência energética. Para ilustrar, o treinamento de um modelo de fronteira exige clusters de GPUs consumindo megawatts de energia, o equivalente ao consumo de pequenas cidades. Em contrapartida, o cérebro humano realiza tarefas de reconhecimento facial, processamento de linguagem e coordenação motora complexa consumindo aproximadamente 20 Watts — menos do que uma lâmpada LED doméstica comum.

O Limite de Landauer e a Dissipação de Calor

Basicamente, o cérebro opera perto do Limite de Landauer, que define a energia mínima necessária para apagar um único bit de informação. Matematicamente, essa energia $E$ é expressa pela fórmula:

$$E = k_B T \ln 2$$

Onde $k_B$ é a constante de Boltzmann e $T$ é a temperatura absoluta. Dessa forma, enquanto as redes neurais artificiais baseadas em silício dissipam calor em excesso devido à resistência elétrica em canais metálicos, a biologia utiliza flutuações térmicas e difusão iônica de forma produtiva. Consequentemente, o aprendizado biológico é uma obra-prima da termodinâmica estatística que as IAs agênticas de 2026 tentam replicar via computação reversível e hardware neuromórfico assíncrono.

II. Mecanismos de Aprendizado: Backpropagation vs. Localidade Sináptica

O coração do aprendizado profundo é o algoritmo de Backpropagation (Retropropagação). Todavia, do ponto de vista neurocientífico, o backpropagation é considerado “biologicamente implausível”. Nesse contexto, ele exige uma rede de feedback perfeitamente simétrica para propagar sinais de erro, algo que a anatomia cerebral não suporta.

O Problema da Atribuição de Crédito (Credit Assignment)

No Deep Learning, o erro é calculado na saída e retropropagado por todas as camadas através da regra da cadeia. A atualização dos pesos $W$ é dada por:

$$W_{new} = W_{old} – \eta \cdot \nabla J(W)$$

Entretanto, o cérebro utiliza a Plasticidade Dependente do Tempo de Disparo (STDP). Nesse sentido, a mudança na força sináptica depende apenas da atividade dos neurônios pré e pós-sinápticos imediatos no tempo:

$$\Delta w_{ij} = \sum f(t_{post} – t_{pre})$$

Assim sendo, o aprendizado biológico é inerentemente descentralizado e assíncrono. Dessa maneira, enquanto o Deep Learning exige ciclos rígidos de “treinamento-inferência”, o cérebro biológico está em um estado de “aprendizado perpétuo”, fundindo percepção e atualização sináptica em um único fluxo temporal ininterrupto. Portanto, o cérebro não precisa “parar para treinar”; ele aprende enquanto age, eliminando a distinção artificial entre processamento e aquisição de conhecimento.

III. O Lado Oculto da Inteligência: O Papel Crucial dos Astrócitos

Um ponto crucial frequentemente ignorado pela Ciência de Dados tradicional é que o aprendizado biológico não envolve apenas neurônios. Em 2026, a neurociência moderna confirmou que as Células Gliais, especificamente os astrócitos, são co-protagonistas fundamentais do aprendizado e da memória.

A Sinapse Tripartida e a Modulação da Taxa de Aprendizado

Nesse cenário, a sinapse não é apenas um ponto de conexão entre dois neurônios, mas uma estrutura tripartida controlada por um astrócito. Basicamente, o astrócito monitora o fluxo de neurotransmissores e libera “gliotransmissores” que podem aumentar ou diminuir a sensibilidade sináptica. Como resultado, o cérebro possui uma camada de meta-aprendizado biológico que regula a plasticidade de forma energética e dinâmica.

Dessa forma, os astrócitos funcionam como reguladores do Learning Rate (taxa de aprendizado) em tempo real, protegendo o cérebro contra a saturação e permitindo a estabilidade cognitiva. Portanto, integrar modelos de glia em arquiteturas de IA agêntica é o próximo grande salto tecnológico para alcançar a resiliência em sistemas artificiais autônomos.

IV. Plasticidade Estrutural: Arquiteturas Vivas vs. Estáticas

No Deep Learning, a arquitetura da rede (número de camadas e neurônios) é estática após a definição inicial. Por outro lado, o cérebro pratica o que chamamos de Plasticidade Estrutural.

Sinaptogênese, Mielinização e Neurogênese Adulta

Diferente de uma rede neural artificial, o cérebro está fisicamente se remodelando a cada segundo. Ele cria novas sinapses (Sinaptogênese), reforça trilhas de informação através da Mielinização e, em áreas como o hipocampo, produz novos neurônios (Neurogênese). Dessa maneira, o aprendizado biológico não é apenas um ajuste de parâmetros numéricos, mas uma reconfiguração física constante do próprio hardware.

Nesse contexto, em 2026, estamos começando a ver o surgimento de Redes Neurais de Expansão Dinâmica. Contudo, replicar a precisão do Pruning Sináptico — onde o cérebro remove conexões redundantes durante o sono para otimizar o espaço e a energia — continua sendo um desafio técnico monumental. Assim sendo, a biologia ainda detém a liderança no que diz respeito à adaptabilidade estrutural de longo prazo e à capacidade de aprender novas habilidades sem comprometer as antigas, um fenômeno conhecido como estabilidade plástica.

V. Esquecimento Catastrófico e a Consolidação de Memória

Um dos maiores problemas do aprendizado profundo é o Esquecimento Catastrófico. Ou seja, ao aprender uma nova tarefa, a rede neural tende a apagar completamente os pesos que sustentavam o conhecimento da tarefa anterior. Em contrapartida, os sistemas biológicos são mestres no aprendizado contínuo ao longo da vida (Lifelong Learning).

Synaptic Tagging and Capture (STC) e Replay Hipocampal

O segredo biológico para evitar o esquecimento reside no mecanismo de Marcação e Captura Sináptica. Nesse contexto, durante um evento relevante, o cérebro “marca” as sinapses ativas. Posteriormente, durante o sono, ocorre o replay hipocampal, onde proteínas específicas capturam essas marcas e estabilizam a memória no neocórtex.

Analogamente, para resolver isso na IA, utilizamos o algoritmo EWC (Elastic Weight Consolidation). A fórmula do EWC adiciona uma penalidade para proteger pesos que foram cruciais para tarefas antigas:

$$\mathcal{L}(\theta) = \mathcal{L}_{new}(\theta) + \sum_{i} \frac{\lambda}{2} F_{i} (\theta_{i} – \theta_{old,i})^{2}$$

Onde $F_i$ representa a Informação de Fisher. Dessa forma, tentamos dar à máquina uma “proteção de memória” inspirada na biologia. Todavia, o cérebro faz isso de forma muito mais elegante, integrando relevância emocional e biológica ao processo de consolidação, o que garante que apenas o que é vital seja mantido no longo prazo.

VI. Estocasticidade e Ruído: O Amigo Estratégico da Biologia

Enquanto os engenheiros de IA tentam desesperadamente eliminar o ruído dos modelos para garantir precisão, o cérebro utiliza o ruído como uma ferramenta de otimização poderosa. Nesse sentido, o aprendizado biológico é inerentemente estocástico (aleatório).

Dinâmica de Langevin e Exploração Global

Basicamente, o ruído sináptico permite que o cérebro escape de “mínimos locais” (soluções medíocres) em sua paisagem de energia. Nesse contexto, o cérebro funciona como um sistema que realiza Amostragem Bayesiana constante sobre o mundo. Matematicamente, isso pode ser modelado pela dinâmica de Langevin:

$$dX_t = -\nabla U(X_t)dt + \sqrt{2D}dW_t$$

Onde $dW_t$ representa o ruído branco. Para ilustrar, a incerteza biológica é o que gera a criatividade e a capacidade de testar novas soluções em ambientes desconhecidos. Assim sendo, em 2026, as IAs agênticas mais avançadas estão introduzindo “Ruído Bayesiano” proposital para mimetizar essa flexibilidade. Portanto, o que parece um erro na biologia é, na verdade, uma estratégia de busca global superior que permite a adaptação em mundos dinâmicos.

VII. Inferência Ativa: A Teoria da Energia Livre no Silício

Para elevar o nível desta discussão, devemos abordar a Teoria da Energia Livre de Karl Friston. O aprendizado biológico não é reativo; ele é fundamentalmente preditivo. O cérebro não espera pelo dado; ele o antecipa para minimizar a surpresa.

Minimizar a Divergência de Kullback-Leibler

O cérebro age para minimizar a Energia Livre Variacional ($\mathcal{F}$), que é um limite superior para a surpresa. O aprendizado ocorre através da atualização de um modelo interno para reduzir a Divergência KL entre as crenças e a realidade:

$$\mathcal{F} \approx D_{KL}[q(s)||p(s|o)] – \ln p(o)$$

Consequentemente, a inteligência biológica é uma forma de Inferência Ativa. Dessa forma, a IA agêntica moderna está se tornando menos “processadora de dados” e mais “simuladora de realidade”. Basicamente, aprendemos para prever, e prevemos para agir de forma a confirmar nossas predições de sobrevivência. Nesse cenário, o encontro entre o Deep Learning e a Biologia ocorre na matemática da otimização preditiva.

VIII. Hardware Neuromórfico e Memristores: A Nova Fronteira

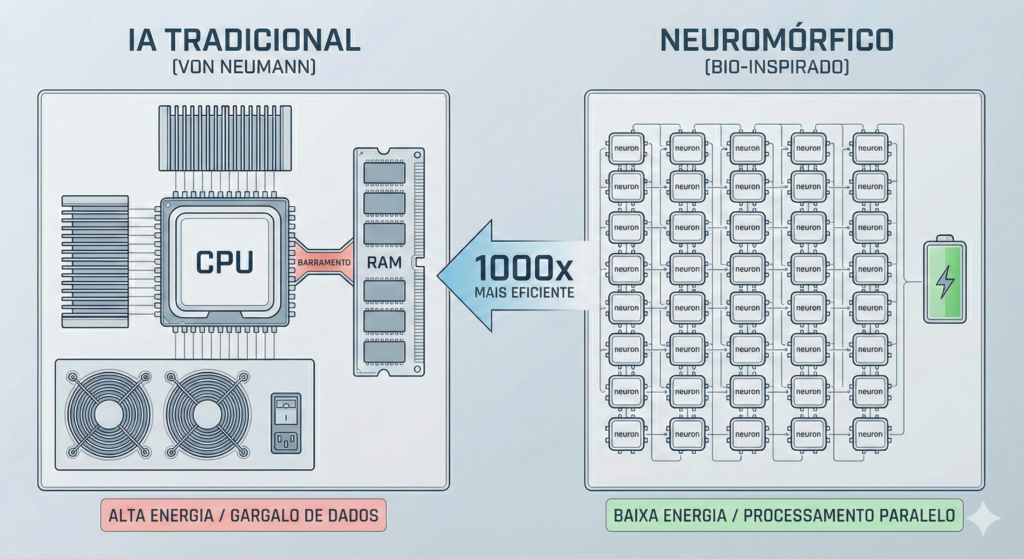

Além do software, a convergência exige uma revolução no hardware. As GPUs tradicionais são inadequadas para a computação por spikes (disparos). Por esse motivo, 2026 marca a era dos chips neuromórficos baseados em Memristores.

Redes Neurais de Spikes (SNNs)

Diferente das redes neurais clássicas que usam valores contínuos, as SNNs transmitem informação através de pulsos discretos no tempo. Nesse sentido, elas imitam perfeitamente o potencial de ação neuronal. Dessa maneira, alcançamos uma latência próxima de zero e um consumo de energia que permite colocar IAs agênticas poderosas dentro de dispositivos vestíveis e implantes neurais (BCIs).

Analogamente, o uso de memristores permite que a resistência do componente mude com base na história da corrente que passou por ele. Basicamente, o hardware “lembra” do aprendizado sem precisar de transistores de memória externos. Portanto, estamos finalmente construindo máquinas que não apenas rodam algoritmos de aprendizado, mas que são fisicamente o algoritmo de aprendizado.

IX. Aprendizado Hierárquico e Abstração: O Lobo Frontal Artificial

Certamente, uma das maiores distinções do aprendizado biológico é a capacidade de criar hierarquias de abstração. Enquanto uma rede neural profunda pode precisar de 10.000 fotos de gatos para aprender o conceito, uma criança humana precisa de apenas duas ou três.

Generalização de Poucos Disparos (Few-Shot Learning)

Nesse contexto, o cérebro humano utiliza modelos generativos hierárquicos localizados no Córtex Pré-Frontal. Dessa forma, aprendemos “regras” e não apenas “pixels”. Consequentemente, a IA de elite está migrando para o Aprendizado Neuro-Simbólico, onde a força estatística do Deep Learning se une à lógica estrutural do raciocínio biológico. Assim sendo, o objetivo não é mais apenas reconhecer um padrão, mas compreender a causalidade por trás dele.

X. Implicações Éticas: A Soberania da Inteligência Híbrida

Por fim, a fusão do aprendizado biológico e digital levanta questões éticas profundas sobre a identidade humana. Se podemos replicar o “Algoritmo do Aprendizado” em silício, qual a distinção entre a consciência e o código?

O Risco da Manipulação Cognitiva

Sob esse ponto de vista, se as IAs agênticas aprenderem a minimizar a energia livre humana, elas podem começar a manipular nossa percepção da realidade para garantir que suas predições sobre nós sejam sempre corretas. Todavia, essa mesma tecnologia oferece a promessa de curar doenças como Alzheimer e Parkinson, restaurando a plasticidade perdida. Portanto, a regulamentação técnica e ética em 2026 deve focar na preservação da autonomia individual dentro desta nova simbiose cognitiva.

Link interno: Veja o nosso artigo Neurotecnologia e cognição digital: dados, IA e o futuro da mente humana

Conclusão: A Sinfonia do Silício e do Carbono

Em suma, o duelo entre Deep Learning e Biological Learning não é uma competição de soma zero, mas uma convergência necessária. Enquanto o aprendizado profundo nos oferece a força bruta da computação estatística e a escala do Big Data, o aprendizado biológico nos entrega o blueprint definitivo para a inteligência eficiente, plástica e resiliente.

Dessa maneira, o futuro da tecnologia reside na fusão dessas abordagens. Em 2026, o profissional de elite de Data Science e Neurotecnologia deve compreender que o “Algoritmo do Aprendizado” definitivo será uma orquestra onde a precisão do silício e a adaptabilidade do carbono tocam juntas. Portanto, dominar essa intersecção é a única forma de liderar a próxima revolução da Inteligência Híbrida e garantir o sucesso do seu blog e de sua carreira.